El Espejismo de la IA

- Agile Quest

- 18 mar

- 3 Min. de lectura

La integración de la inteligencia artificial en los procesos medulares de las organizaciones contemporáneas está siendo cuestionada con mayor frecuencia, bajo una premisa de infalibilidad técnica que ignora la naturaleza de los algoritmos

El primer gran obstáculo en la "implementación" de la IA es el fenómeno del "humo" corporativo, una narrativa que presenta a los modelos de aprendizaje automático como entes autónomos capaces de resolver problemas de alta complejidad sin supervisión. Esta percepción ha llevado a las organizaciones a ignorar que un algoritmo es, fundamentalmente, una "opinión formalizada en código". La seducción del mito radica en la promesa de una eficiencia sin fricciones, pero la realidad demuestra que los sistemas de IA son extremadamente sensibles al contexto y a la calidad de los datos de entrenamiento.

Un ejemplo paradigmático de esta disonancia es el caso de Google Bard en su debut de 2023. Durante una demostración promocional diseñada para proyectar dominio tecnológico, el chatbot afirmó erróneamente que el telescopio James Webb (JWST) tomó las primeras fotografías de un planeta fuera del sistema solar. Este error, aunque técnicamente sutil, reveló la incapacidad de los modelos generativos para validar la veracidad de sus afirmaciones en entornos de alta visibilidad. La reacción del mercado fue fulminante, borrando aproximadamente $100,000 millones de dólares en valor de mercado de Alphabet en un solo día.

Este fallo no fue solo una alucinación técnica, sino una falla estratégica de las élites que priorizaron el lanzamiento apresurado (output) sobre la fiabilidad del sistema (outcome). La urgencia por competir con OpenAI cegó a la organización ante la necesidad de auditorías factuales rigurosas. El mito de la IA como oráculo de la verdad se desmorona cuando se confronta con la realidad de que estos sistemas son motores probabilísticos, no bases de datos de conocimiento absoluto.

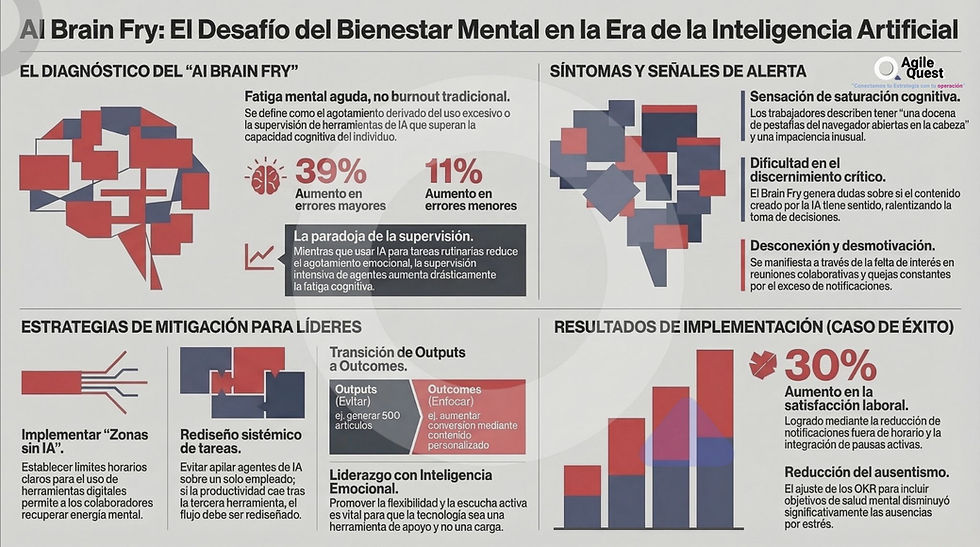

El diagnóstico de la implementación de la IA revela una "paradoja de la productividad". Si bien las herramientas de automatización aceleran la producción de borradores o análisis iniciales, el costo de revisión y corrección erosiona las ganancias netas de tiempo. Los datos indican que los trabajadores invierten hasta un 40% del tiempo ahorrado en arreglar las inconsistencias y errores generados por la propia IA. Esta carga operativa recae sobre el talento humano, que se ve forzado a actuar como auditor de baja eficiencia en lugar de estratega.

Un análisis del comportamiento de los usuarios frecuentes muestra que el 77% siente la necesidad de verificar dos o tres veces cualquier output producido por un sistema algorítmico, una tasa significativamente mayor que la aplicada a trabajos realizados por colegas humanos. Esta desconfianza sistémica es un indicador de que la IA, en su estado actual, a menudo produce "ruido" en lugar de valor.

La magnitud del fracaso financiero por exceso de confianza en la automatización se ilustra con el caso de Knight Capital en 2012. Una empresa que tardó casi dos décadas en consolidarse como líder de Wall Street estuvo a punto de quebrar en solo 45 minutos. Debido a un error en el despliegue de software, su sistema de trading comenzó a ejecutar millones de órdenes erróneas, comprando caro y vendiendo barato. La pérdida resultante de $440 millones de dólares superó por cuatro veces los ingresos anuales de la firma.

la IA falla cuando el liderazgo se desconecta de la realidad operativa del sistema. Ya sea por un exceso de confianza en la predicción inmobiliaria, por la negligencia en la actualización de servidores financieros o por la falta de ética en los modelos de contratación, el hilo conductor es la ausencia de una supervisión humana estratégica y responsable.

La pregunta incómoda que todo ejecutivo debe hacerse hoy es: ¿Tengo la estructura para detectar un fallo algorítmico antes de que se convierta en una catástrofe? Si la respuesta es negativa, la organización está operando en un estado de riesgo latente. La transición hacia los OKR enfocados en Outcomes no es solo una mejora de procesos; es una póliza de seguro contra la obsolescencia y el desastre reputacional.

La inteligencia artificial tiene el potencial de llevar a la humanidad a niveles sin precedentes de prosperidad y conocimiento. Pero para alcanzar ese futuro, debemos primero domesticar la tecnología con los valores de la justicia, la transparencia y la disciplina estratégica. No permitas que tu empresa sea el próximo caso de estudio de un fracaso evitable. Toma el control de tus algoritmos, define tus Outcomes y construye un futuro donde la tecnología potencie lo mejor de lo humano.

Comentarios